論文読み:Predicting Depth, Surface Normals and Semantic Labels with a Common Multi-Scale Convolutional Architecture

2015年にFacebook AI Researchから発表された論文「Predicting Depth, Surface Normals and Semantic Labels with a Common Multi-Scale Convolutional Architecture」について読んだのでメモ。

今となっては目新しい手法ではないように思うけど(あまり深度・法線推定の論文は読んではいないけど)深度・法線推定の推定結果がセグメンテーション精度の向上に役に立つのか?という考察が面白かった。

Abstract

- 単一のマルチスケールCNN構造による深度推定・法線推定・セマンティックセグメンテーションを対象とする

- SuperpixelやLow-levelセグメンテーション等(どちらもkMeansのようなをクラスタリング?)必要とせずに連続する異なるスケールを利用し推定結果を補正することができる

概要

-

様々な応用に繋がるようOff-the-shelfな回帰モデルの構築に取り組んだ

-

同様の理由から単一のアーキテクチャを用いた

-

深度と法線の推定では計算を共有することで効率化した

新規性・差分

- マルチスケールによる連続的な処理を取り入れたところ?

手法

本論文のモデルはFig.1のとおり。入力画像の解像度は320x240で、出力は147x109。

結果

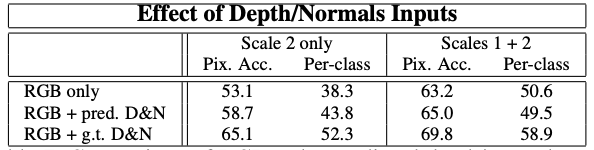

- Table 6.のとおりマルチスケールは効果があった

- Scale 1の粗めのスケールはDepth、Normal推定に役立っている

- Table 7.よりScale 1+2の際に、Depth、Normal推定結果は精度向上に寄与しなかった

- 上記の理由はおそらく、セグメンテーション時にDepth、Normal推定にも繋がるような関係性を学習しているからであり、GT情報であれば役に立つが推論結果では役に立たないということだと考えられる

なんかちょっと英語的に読みづらかった。特にDepth、Normalの出力とScaleの関係があまりはっきり把握できなかった。結構論文の書き手によってすっと読めるのと何回か読み返しても???となるところが多い論文があるなぁ。もっと英語も精進が必要。